前回のTSA-120に引き続き、VISAC (VC200L) でM13を撮影してみました。

と言っても撮影したのは前回の画像処理をする前。なので、反省点は生きていません。撮影条件なども基本的には同じです。

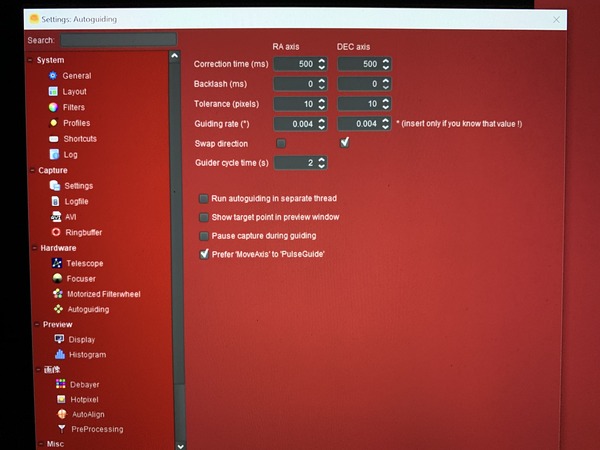

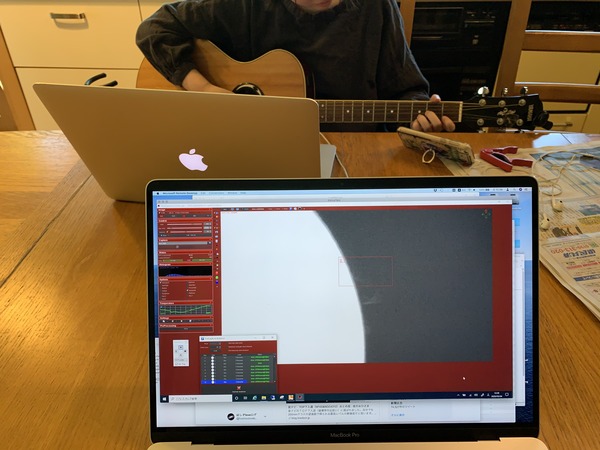

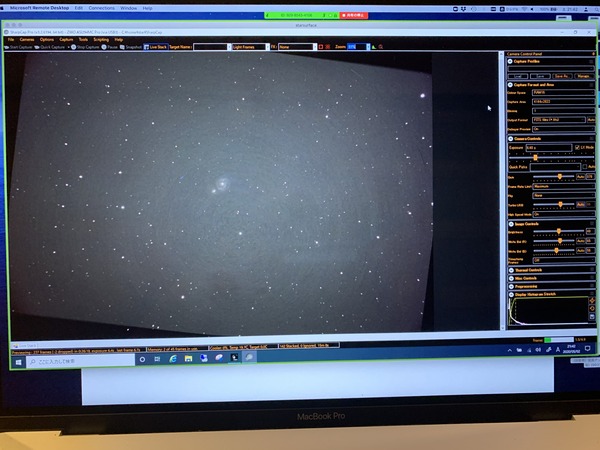

大きく変わったのは、鏡筒はもちろんですが、撮影時間を3時間以上と大幅に増やしたこと。まあこれも増やしたと言うよりは、放って置いたら3時間経ってたと言うのが正しいので、3時間に「増えてしまった」と言った方がいいのかもしれません。あと、撮影にN.I.N.A.を使ってみました。結構よかったので、これは次の記事でレポートします。

撮影時に気づいたことといえば、TSA-120は鏡筒自身が長いので時間が経つとCMOSカメラ側が三脚に当たって、それで撮影が終わることが多いのですが、VISACは焦点距離が長いのに物理的な長さは短いので全然大丈夫なことです。実際、M13が天頂を超えてしまって、あーもう当たってるかもと思って急いで見に行ったらまだ全然余裕で、その後30分くらい撮影を延長しました。

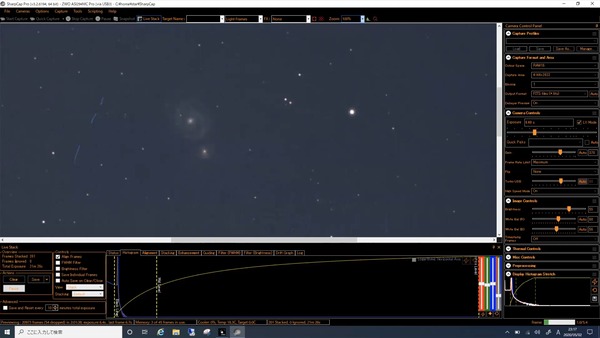

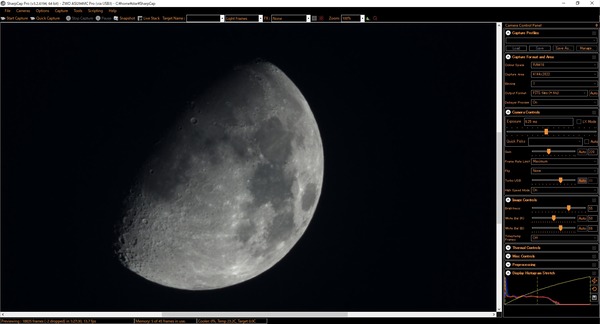

撮影結果です。

中心部です。

画像処理をした後の、いくつかの反省点と検討事項です。

背景をわかりやすくするためにガンマを上げたものを載せておきます。

微光星とノイズがはっきりと見分けがついているところが今回進歩したところでしょうか。

その一方、よくみると背景に黒いシミのようなものがたくさんあるのがわかります。これがどこから来ているのか不明です。周辺減光を見てもわかりますが、今回フラット補正をしていないので、フラット補正をしたらうまく取れるかもしれません。まだフラット補正に絶対の自信がなく、出来る限り躊躇してしまっています。きちんと検証するいい機会なのかもしれません。

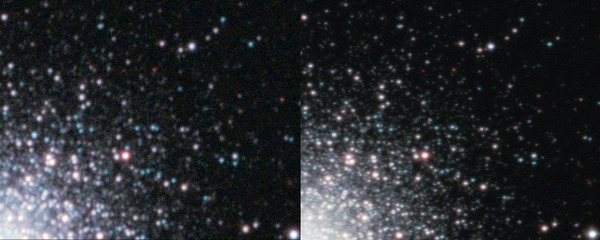

面白いのはここからです。M13の画像をTSA120とVISACの場合で比較してみました。日にちも条件も違うので、完全な直接比較にはならないのですが、いくつか面白いことがわかりました。わかりやすいように、中心部の画像の右上4分の1を切り取って並べます。左がTSA-120、右がVISACになります。

まず、分解能についてですが、VISACの方が圧勝です。そもそも焦点距離が倍以上長いので、同じCMOSカメラで撮影した場合焦点距離の長いVISACの方が有利です。また、VISACの方が撮影時間3時間以上と3倍近い時間をかけているので、背景ノイズが小さくなっていて、微光星がよりはっきりと分離されています。

一方、明るい恒星に関しては隣同士の距離がTSA-120でもVISACでもあまり違いがありません。ここら辺はトラペジウムのE、F星がTSA-120では余裕で見えて、VISACでは見えたことがないというところに通じるのかもしれません。もちろん、両撮影とも5分と露光時間が長いので、共に明るい星が肥大化してしまった可能性もあります。

星の色についてですが、基本的に白、オレンジっぽい赤、緑よりの青の3つに分かれるのは前回と同じです。赤と青がバラバラに散らばっているので、収差とかではなさそうです。また、どの星がどの色になるのかの再現性はあるようです。QBPのせいかなとも思ったのですが、他の方の画像を見ても同じように3種に分かれているのが多いです。やはりフィルターが入っているのかとも思ったのですが、Wikipediaの写真や、NASAの写真も同じような傾向です。これは一般的にこれで正しいのか?これも課題の一つです。

VISACの星像が横に伸びてしまっています。光学系のせいなのか、撮影時の流れなのか不明ですが、解決しなくてはダメそうです。TSA-120は流石に真円に近いです。

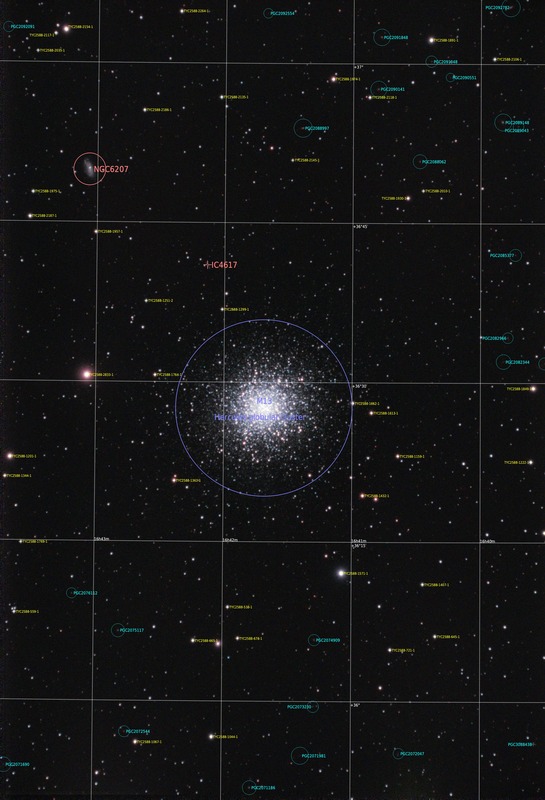

次に、左上のICIC4617周りを比較してみます。左がTSA-120、右がVISACです。

さて、VISACによる3時間撮影で、微光星の分解能は格段に上がりました。でも明るい恒星の肥大問題はまだ存在しているようです。こうやって考えると

TSA-120で10秒クラスの短時間露光撮で他数枚というのが手持ちの機器では解なのかもしれません。

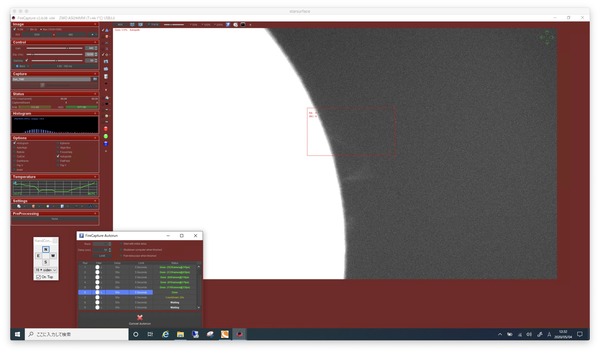

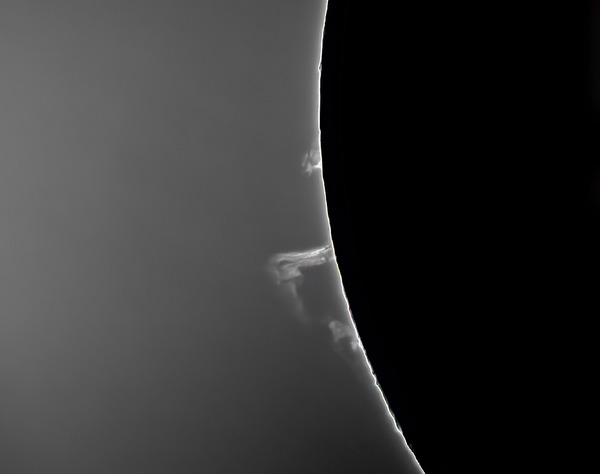

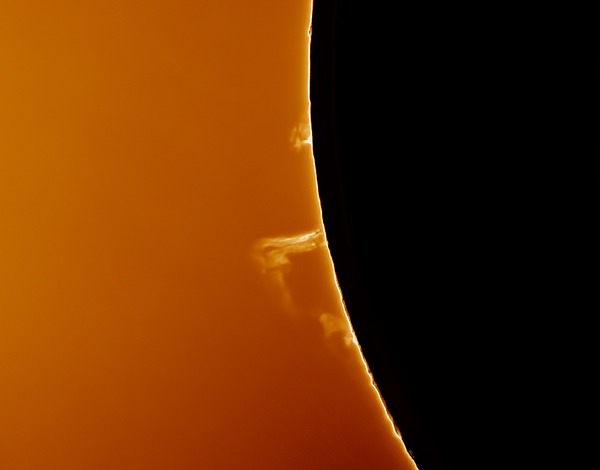

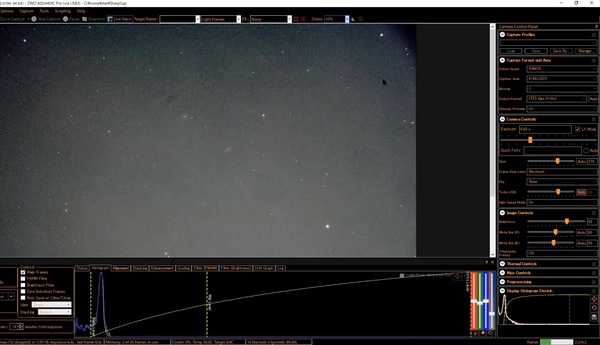

撮影時の様子と結果

と言っても撮影したのは前回の画像処理をする前。なので、反省点は生きていません。撮影条件なども基本的には同じです。

大きく変わったのは、鏡筒はもちろんですが、撮影時間を3時間以上と大幅に増やしたこと。まあこれも増やしたと言うよりは、放って置いたら3時間経ってたと言うのが正しいので、3時間に「増えてしまった」と言った方がいいのかもしれません。あと、撮影にN.I.N.A.を使ってみました。結構よかったので、これは次の記事でレポートします。

撮影時に気づいたことといえば、TSA-120は鏡筒自身が長いので時間が経つとCMOSカメラ側が三脚に当たって、それで撮影が終わることが多いのですが、VISACは焦点距離が長いのに物理的な長さは短いので全然大丈夫なことです。実際、M13が天頂を超えてしまって、あーもう当たってるかもと思って急いで見に行ったらまだ全然余裕で、その後30分くらい撮影を延長しました。

撮影結果です。

「M13: ヘラクレス 座球状星団」

- 撮影日: 2020年5月14日21時9分-5月15日0時48分

- 撮影場所: 富山県富山市下大久保

- 鏡筒: Vixen VC200L

- 赤道儀: Celestron CGEM II

- カメラ: ZWO ASI294MC Pro + サイトロン QBP (37.5mm)

- ガイド: PHD2 + f=120mmガイド鏡 + ASI290MMによるディザリング

- 撮影: N.I.N.A.、ゲイン220、温度-15℃、露光時間300秒x38枚 = 3時間10分

- PixInsight、Photoshop CCで画像処理

中心部です。

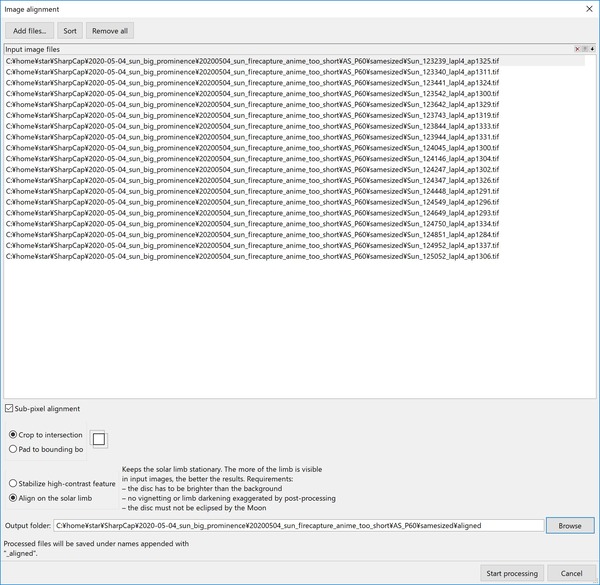

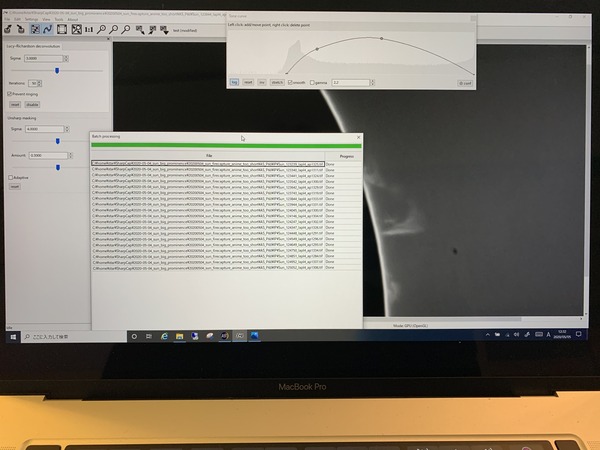

画像処理について

画像処理をした後の、いくつかの反省点と検討事項です。

- StarNet++を試しましたが、相当明るい構成のみを一部分離できただけで、使い物になりませんでした。球状星団には向いていないです。

- 背景ノイズを消す目的で試したのですが、相変わらずDfine2もDeNoise AIも微光星が崩れしまって、悪影響の方が大きいです。今回も使いませんでした。

- 露光時間が長いので背景ノイズが滑らかになり、微光星とはかなりはっきり分離できています。逆に一番の問題は、露光時間が長いのでやはり星像にシャープさが無いこと。シャープさを出すために、Sharpen AIとNik collectionのSharpner Proとか色々試しましたがほぼ全滅で、唯一まともだったのがPixInsightのDecombolutionでした。ちなみに、月とかでRegistax代わりに使うMultiscaleLinearTransformも背景ノイズが増えたように見えるのでダメでした。

- Decombolutionはまだあまりパラメータとか理解できていないので、ほぼデフォルト。Wavelet layerはデフォルトの2つだと不十分なようで、4つに増やしました。他にかなり効いたところがDeringingです。これもデフォルト設定ですが、オンにすると背景のノイズの崩れ具合がかなり改善されました。このおかげでシャープさが少し回復したのかと思います。

- まだ口径200mmの分解能には迫っているとは思えません。特に明るい星が肥大化してしまうのはコントラストなども関わってくるので、難しいです。

- 具体的に言うと、星が密になる境のあたりに3つ赤い星が固まっていて、一番外側の星の横に青い小さな星があるのですが、この3つの星がどうしてもくっつきがちです。シャープな画像を見ているともっと分離しています。次に短時間露光を試すときに、ここの分解能を出せるのかどうかがポイントかと思っています。

- 以前問題になった、星像おにぎり化現象、一旦は出なくなったのですがはたして今回はと言うと、とりあえず星像を見る限り丸で、どうやら大丈夫なようです。でもこれまだ、調整不足で星像が肥大化して見えなくなっただけの可能性もあるので、結論は先送りです。

背景について

背景をわかりやすくするためにガンマを上げたものを載せておきます。

微光星とノイズがはっきりと見分けがついているところが今回進歩したところでしょうか。

その一方、よくみると背景に黒いシミのようなものがたくさんあるのがわかります。これがどこから来ているのか不明です。周辺減光を見てもわかりますが、今回フラット補正をしていないので、フラット補正をしたらうまく取れるかもしれません。まだフラット補正に絶対の自信がなく、出来る限り躊躇してしまっています。きちんと検証するいい機会なのかもしれません。

TSA-120の画像とVISACの画像の比較

面白いのはここからです。M13の画像をTSA120とVISACの場合で比較してみました。日にちも条件も違うので、完全な直接比較にはならないのですが、いくつか面白いことがわかりました。わかりやすいように、中心部の画像の右上4分の1を切り取って並べます。左がTSA-120、右がVISACになります。

まず、分解能についてですが、VISACの方が圧勝です。そもそも焦点距離が倍以上長いので、同じCMOSカメラで撮影した場合焦点距離の長いVISACの方が有利です。また、VISACの方が撮影時間3時間以上と3倍近い時間をかけているので、背景ノイズが小さくなっていて、微光星がよりはっきりと分離されています。

一方、明るい恒星に関しては隣同士の距離がTSA-120でもVISACでもあまり違いがありません。ここら辺はトラペジウムのE、F星がTSA-120では余裕で見えて、VISACでは見えたことがないというところに通じるのかもしれません。もちろん、両撮影とも5分と露光時間が長いので、共に明るい星が肥大化してしまった可能性もあります。

星の色についてですが、基本的に白、オレンジっぽい赤、緑よりの青の3つに分かれるのは前回と同じです。赤と青がバラバラに散らばっているので、収差とかではなさそうです。また、どの星がどの色になるのかの再現性はあるようです。QBPのせいかなとも思ったのですが、他の方の画像を見ても同じように3種に分かれているのが多いです。やはりフィルターが入っているのかとも思ったのですが、Wikipediaの写真や、NASAの写真も同じような傾向です。これは一般的にこれで正しいのか?これも課題の一つです。

VISACの星像が横に伸びてしまっています。光学系のせいなのか、撮影時の流れなのか不明ですが、解決しなくてはダメそうです。TSA-120は流石に真円に近いです。

次に、左上のICIC4617周りを比較してみます。左がTSA-120、右がVISACです。

調べてみるとIC4617が15.14等級だそうです。Stellariumが18等級までデータを持っていて、改めて画像を見ると17等級後半とかは余裕で見えています。例えば、IC4617の右上にある3つ並んだ星の一番遠い矢印で指しているのが17.8等級です。VISACだと余裕ですが、TSA-120だとギリギリ見えてるかどうかというところでしょうか。

VISACはさらに暗い星が見えているようですが、もうデータがないので何等級かわかりません。きちんとデータと比べて限界等級を知っておきたい気もします。

VISACはさらに暗い星が見えているようですが、もうデータがないので何等級かわかりません。きちんとデータと比べて限界等級を知っておきたい気もします。

まとめと、今後の課題

さて、VISACによる3時間撮影で、微光星の分解能は格段に上がりました。でも明るい恒星の肥大問題はまだ存在しているようです。こうやって考えると

- VISACで10秒クラスの短時間露光撮影

- TSA-120でシンチレーションのいい日に3時間クラスの長時間撮影

TSA-120で10秒クラスの短時間露光撮で他数枚というのが手持ちの機器では解なのかもしれません。